Les intelligences artificielles (IA) comme Gemini, ChatGPT ou d’autres modèles conversationnels font désormais partie de notre quotidien. Ces outils, conçus pour imiter le langage humain, peuvent paraître neutre. Pourtant, les biais religieux sont bel et bien présents.

Victor Costa, directeur de la stratégie digitale de la mission web et pionnier en matière du développement de l’IA dans le monde protestant réformé, insiste sur un point essentiel : les Large Language Models (appelés LLM) , comme ChatGPT, sont des IA conçues pour analyser et générer du texte à partir d’une importante base de données. Cela leur confère une capacité unique à fournir des réponses variées et nuancées. « Dès que l’on pose des questions, que ce soit en lien avec la religion ou autre, les réponses sont très inclusives, très progressistes. ChatGPT ne tranchera pas sur une direction » affirme Monsieur Costa. Cette neutralité apparente découle de leur programmation. Ces modèles sont entraînés à éviter les opinions polarisées et à proposer plusieurs perspectives, notamment sur les sujets polémiques.

ChatGPT : à l’origine d’une religion pas si neutre que ça

Face à une question sur l’existence de Dieu, ChatGPT propose des arguments pour et contre, reflétant la diversité des croyances humaines. Mais après l’avoir questionné sur la religion idéale qui pourrait exister, l’IA répond : « l’harmonisme » Principes fondamentaux, valeurs éthiques, principes spirituels, enseignement, concept divin, structure communautaire, tout est généré avec de nombreux détails. L’IA explique s’inspirer des diverses autres religions du monde.

En déclarant que » chacun se doit d’accepter les différences et encourager les gens à vivre en harmonie » ou bien qu’un des piliers soit « le Respect de la Nature », on remarque que l’IA met en avant des valeurs politiques, écologiques et humaines avec qui tout le monde ne serait pas d’accord. Bien que l’IA tente de paraitre neutre, la réponse transmise laisse paraitre des biais idéologiques pouvant influencer le grand public.

Les modèles de langage personnels : le biais assumé

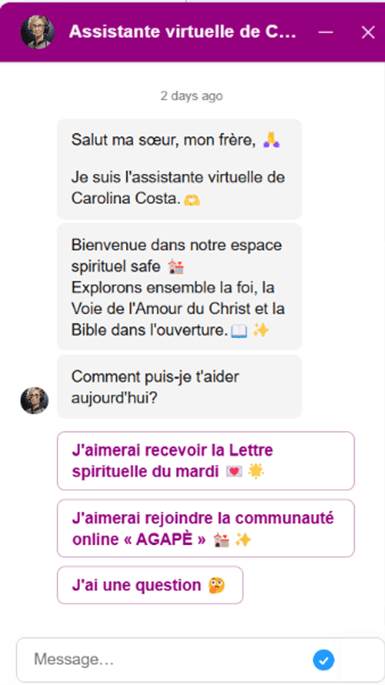

Là où les choses se compliquent, selon un des pionniers de l’IA pour l’Eglise réformée, c’est avec les Personal Language Models (PLM). » Des IA conçues pour s’adapter et répondre aux besoins spécifiques d’un utilisateur ou d’un groupe d’utilisateurs. Dans ce cas, la réponse ne sera pas neutre « , affirme-t-il.

Ces modèles peuvent refléter les croyances et les opinions de leurs concepteurs, voire être intentionnellement biaisés pour répondre à des objectifs précis.

Victor Costa évoque d’ailleurs la création d’une assistante virtuelle pour le blog qu’il tient avec sa femme. Celle-ci a été formée à partir d’un contenu bien spécifique, soit 150 vidéos et une centaine de pages d’un blog précis.

Une telle IA, bien qu’efficace, porte essentiellement les biais cognitifs, idéologiques et religieux des sources qui ont nourri son apprentissage. « Nous sommes dans un monde d’opinions, donc si la personne veut créer une IA avec une certaine vision de la religion, il peut », insiste-t-il.

« Le monde se transforme, il faut suivre«

Victor Costa souligne également un point crucial : les biais dans les IA dépendent avant tout de leurs concepteurs. Une IA développée par une organisation religieuse pourrait être programmée pour refléter ses dogmes, tandis qu’une IA créée dans un contexte académique pourrait viser une objectivité théorique.

À mesure que leur utilisation se généralise, l’éducation et la compréhension de celle-ci devient non négligeable. « Les IA, c’est comme ça ! Il y en a, il y en aura, le progrès continue, donc il faut s’y habituer. Le monde se transforme, il faut suivre, s’y intéresser, comprendre. Ces changements, on a du mal à les accepter, mais ils vont arriver, et à un moment, on ne pourra plus les éviter « .

Le développement rapide de ces technologies soulève des inquiétudes, notamment quant à leur influence sur la véracité des informations. C’est pourquoi, il souligne que : » La différence se fera sur notre connaissance des IA justement « , pour qu’individuellement, chacun apprenne à naviguer parmi les fausses informations et les représentations biaisées.

Naïs MORANDEAU